- Messages : 18379

ChatGPT, nouveau miroir aux alouettes numérique

- Loys

-

Auteur du sujet

Auteur du sujet

Voir aussi :

* * *

Sur "Clubic" (de "Vice" du 17/10/22 : "Quand les étudiants utilisent une IA pour écrire leurs devoirs, la fraude est quasi indétectable"

Quelque chose est masqué pour les invités. Veuillez vous connecter ou vous enregistrer pour le visualiser.

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Vincent Flibustier écrit: Quand tu vois ce que produit en 2 secondes une IA comme la nouvelle version de ChatGPT... Les profs ont du soucis à se faire. Les devoirs, travaux à la maison... C'est terminé.

Twitter, 1er décembre 2022

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Triche à la fac : 50 % des copies rédigées par l’intelligence artificielle ChatGPT

Ce n’était pas exactement les mêmes devoirs. Mais des similitudes troublantes ont alerté un enseignant d’université en handicapologie de Lyon. Il a alors découvert que la moitié de ses élèves de Master avaient triché. Pour rédiger leur copie, ils avaient fait appel à une nouvelle intelligence artificielle surpuissante : ChatGPT.

Sur "LCP" du 17/01/2023, une journaliste admirative :

Delphine Sabattier écrit: "Moi j’ai l’impression qu’on va pouvoir écrire des romans avec ce nouveau robot ou faire les devoirs des enfants".

(sur Twitter)

Quelque chose est masqué pour les invités. Veuillez vous connecter ou vous enregistrer pour le visualiser.

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Comment appréhender l’#IA appliquée à l’éducation? Échanges avec le Ministre @PapNdiaye sur la #formation des enseignants à l’IA #ChatGPT

Clé utilisateur/ secrète de la configuration non valide

Clé utilisateur/ secrète de la configuration non valide

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Dans "Le Monde" (abonnés) du 2/02/2023 : ChatGPT attire les investisseurs, inquiète Google et tente de rassurer les professeurs

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Une vingtaine d'étudiants de l'Université de Strasbourg (Unistra), qui avaient triché à l'aide du chatbot d'intelligence artificielle ChatGPT lors d'un examen en distanciel, ont dû le repasser en présentiel, a-t-on appris vendredi auprès de l'établissement.

"C'est le premier cas à l'Université de Strasbourg et nous n'en avons pas d'autres à ce jour", a indiqué l'Unistra dans un communiqué transmis à l'AFP.

L'examen originel, en ligne, était sous forme de questionnaire à choix multiples (QCM) et portait sur l'histoire du Japon, a-t-on précisé auprès de l'université, confirmant des informations du quotidien régional Les Dernières Nouvelles d'Alsace (DNA).

Les résultats ont toutefois montré une "tricherie" à ChatGPT dans les réponses d'une "vingtaine d'étudiants" qui ont dû passer cette semaine un "rattrapage" en présentiel, a-t-on précisé auprès de l'Unistra.

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

ChatGPT n’est que l’un parmi de nombreux systèmes d’IA, déjà existants, qui vont transformer la société, et nous pouvons nous attendre à ce que d’autres apparaissent bientôt. Au lieu d'essayer d'empêcher les étudiants d'utiliser ChatGPT, nous devons réformer la façon dont nous enseignons.

Par Claire Boine, Université d’Ottawa/University of Ottawa et Céline Castets-Renard, Université Toulouse 1 Capitole

Le débat sur les promesses et les risques de l’intelligence artificielle a été bousculé le 30 novembre 2022, lorsque l’entreprise OpenAI a lancé ChatGPT. ChatGPT est une version améliorée et gratuite de GPT-3, un puissant système lancé en 2020 qui génère du texte. C’est ce qu’on appelle un modèle de langage. GPT-3 a d’ailleurs été utilisé pour rédiger un article d’opinion du Guardian, soutenant que l’IA ne détruira pas les humains.

En décembre, plus d’un million de personnes ont utilisé ChatGPT et publiaient en ligne des codes informatiques, des programmes de recettes hebdomadaires, des présentations de travail et des dissertations générés par le système.

ChatGPT et GPT-3 peuvent également résoudre des problèmes mathématiques, corriger la grammaire ou simplifier un texte compliqué. À l’heure actuelle, ChatGPT ne peut plus répondre à la demande ; le site n’a pas la capacité de supporter le nombre trop élevé d’utilisateurs.

Ayant été entraînés sur une grande quantité de données, notamment des sites Web, des livres et Wikipédia, ces systèmes peuvent imiter différents styles littéraires, et notamment expliquer dans un style biblique comment retirer un sandwich d’un magnétoscope, écrire des poèmes dans le style de Baudelaire ou produire des scénarios de scènes de l’émission à succès Friends.

Pour la première fois, la société saisit pleinement l’ampleur des transformations à venir. Pourtant, une grande partie du débat public sur ChatGPT se concentre sur la question du plagiat à l’école. La crainte, largement répandue, que les étudiants utilisent ChatGPT pour rédiger leurs dissertations distrait le public de questions beaucoup plus importantes.

Expertes en droit et politiques de l’intelligence artificielle, nous proposons d’apporter un éclairage sur les derniers systèmes d’IA et les véritables risques qu’ils présentent.

Bien comprendre les modèles de langage

Les modèles de langage sont des systèmes d’IA entraînés à estimer la probabilité qu’une séquence de mots apparaisse dans un texte. Ils sont utilisés de diverses manières, notamment dans les clavargades virtuels, les applications de messagerie et les logiciels de traduction. Pensez par exemple à votre application de messagerie qui vous suggère le mot suivant dans la phrase que vous avez commencée. Certains modèles de langage sont appelés grands modèles de langage, lorsqu’ils sont entraînés sur un nombre de paramètres très élevé, bien qu’il n’y ait pas de seuil précis pour ce nombre.

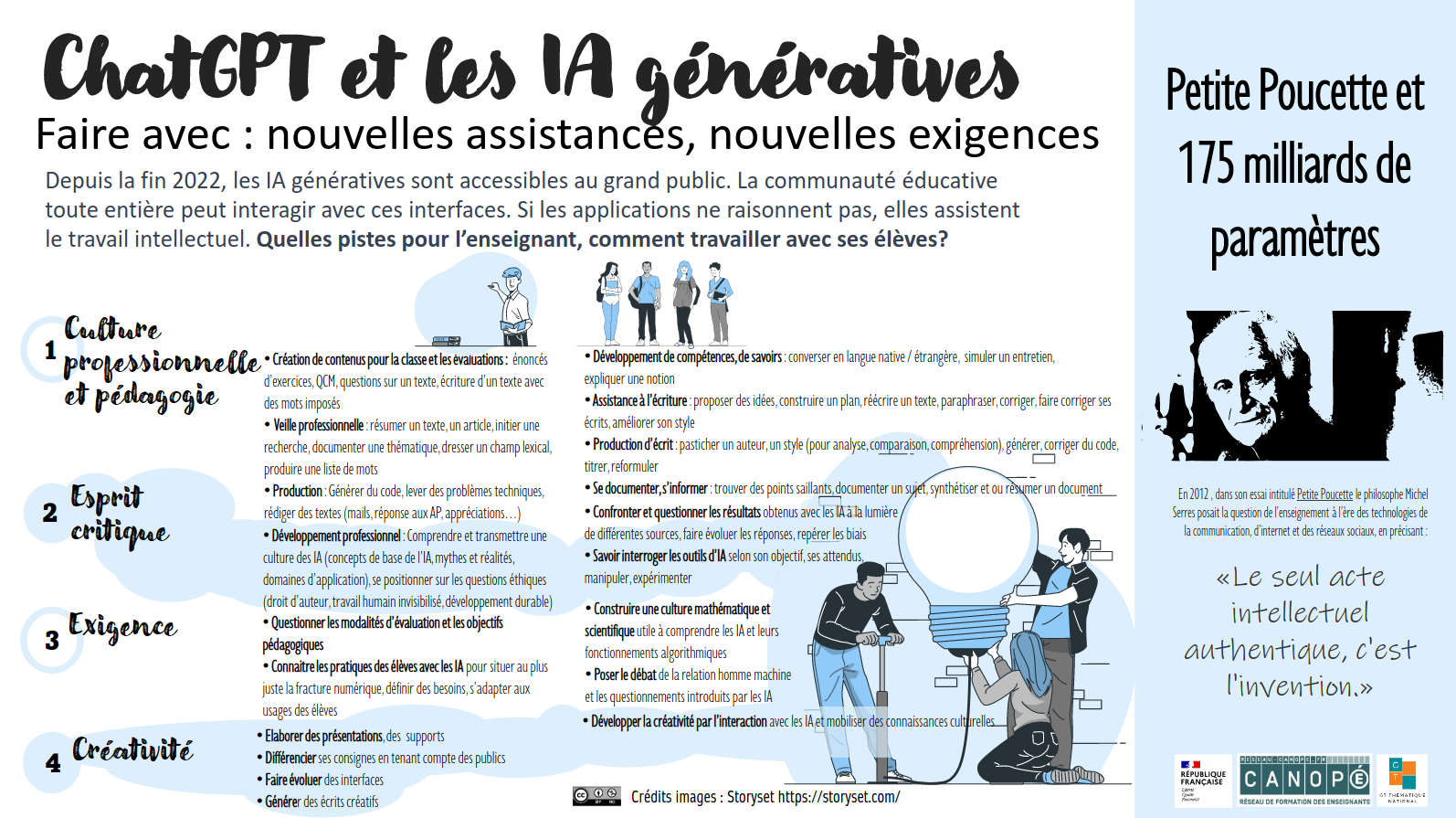

Ces modèles ont été révolutionnés par l’invention d’une nouvelle technologie, appelée transformeurs, en 2017. De nombreux modèles de langage impressionnants utilisant des transformeurs ont vu le jour, tels que GPT-3, Bloom, LaMDA, Megatron-Turing NLG et PaLM. Alors que ChatGPT a été entraîné sur 175 milliards de paramètres, PaLM de Google a été entraîné sur 540 milliards et peut expliquer des blagues et produire des raisonnements logiques sophistiqués. Les transformeurs ont également été utilisés pour créer des systèmes qui génèrent des images à partir de textes, comme DALL.E 2, qui peut produire une image crédible d’un koala qui joue (et marque !) au basketball. En fait, certains artistes utilisent désormais l’IA pour générer leurs œuvres.

Le débat sur le plagiat ne date pas d’hier

L’IA révolutionne actuellement le monde du travail. Des personnes n’ayant aucune formation en programmation peuvent produire des codes informatiques, n’importe qui peut générer des cartes, des diapositives, des dessins, des photos, des sites web, des textes ou des documents juridiques. Les professionnels de demain s’appuieront sans doute sur ces outils. Il convient donc de se poser la question suivante : quel est le but de l’éducation si ce n’est de préparer les étudiants à la société et au travail ?

Un débat sur le plagiat a eu lieu dans les années 90, lorsqu’internet s’est développé. Les professeurs d’université déploraient alors que leurs étudiants copient des informations provenant de sites web et journaux électroniques ou demandent de l’aide sur des forums en ligne. Bien entendu, le fait de ne pas citer ses sources est problématique ; c’est ce qu’on appelle du plagiat. Mais les premiers tricheurs qui utilisaient Internet ont appris à effectuer des recherches sur le Web et à trier les informations. En fait, le système scolaire s’est depuis adapté pour privilégier les aptitudes à recueillir, analyser, synthétiser et évaluer l’exactitude et l’utilité des informations. C’est l’une des raisons pour lesquelles les jeunes adultes d’aujourd’hui sont plus résistants à la désinformation que leurs aînés.

ChatGPT n’est que la pointe de l’iceberg

Aujourd’hui, l’IA introduit une révolution encore plus importante que celle provoquée par l’arrivée d’internet. ChatGPT n’est que l’un parmi de nombreux systèmes d’IA, déjà existants, qui vont transformer la société, et nous pouvons nous attendre à ce que d’autres apparaissent bientôt. Actuellement, les trois ingrédients des systèmes d’IA – la puissance de calcul, les algorithmes et les données – s’améliorent tous à un rythme effréné. ChatGPT n’est que la partie visible de l’iceberg, et nous devons préparer les étudiants aux changements sociaux importants que l’IA va entraîner.

Au lieu d’essayer d’empêcher les étudiants d’utiliser ChatGPT, nous devons réformer la façon dont nous enseignons. Cette réforme ne doit pas consister à trouver des devoirs astucieux pour lesquels les étudiants ne peuvent pas utiliser ChatGPT. Nous devons nous assurer que les étudiants peuvent utiliser les systèmes d’IA correctement.

ChatGPT est formé en partie à partir de rétroaction humaine. Les humains lisent la réponse produite par le système et jugent si elle est véridique et informative. Pour certains sujets, en particulier ceux qui requièrent une expertise approfondie, les réponses peuvent sembler plausibles aux yeux des humains, mais contenir des inexactitudes, qui sont ainsi renforcées. Au fil du temps, il deviendra encore plus difficile pour les humains de remarquer les écarts subtils par rapport à la vérité. Les enseignants pourraient ainsi créer des devoirs qui requièrent l’utilisation de ChatGPT, en demandant aux étudiants de vérifier des faits moins connus et d’apporter des éclairages plus subtils.

ChatGPT, c’est quoi exactement ?

Un appel à la prudence

Mais surtout, nous devons sensibiliser nos étudiants aux risques que présentent ces systèmes. Il a été démontré que les grands modèles de langage reproduisent les biais et préjugés, donnent des conseils potentiellement dangereux et facilitent la manipulation des consommateurs. Bientôt, ces modèles pourraient mener à la manipulation de masse. Ils peuvent également être à l’origine de violations légales de la confidentialité des données et des droits de propriété intellectuelle, sur lesquelles les étudiants doivent rester vigilants.

Qui plus est, les créateurs et les utilisateurs de systèmes d’IA reposant sur des transformeurs découvrent régulièrement que ces systèmes sont capables de tâches, parfois problématiques, dont ils n’avaient pas conscience. Par exemple, des chercheurs ont démontré qu’ils pouvaient utiliser un modèle de langage pour calculer la probabilité que des accusés récidivent, une tâche pour laquelle le modèle n’avait pas été intentionnellement entraîné. Les développeurs des premiers grands modèles de langage ne s’attendaient pas à ce que ceux-ci puissent faire de l’arithmétique ou du raisonnement. Cette imprévisibilité des tâches réalisables avec ces systèmes augmente le risque qu’ils soient utilisés à des fins néfastes ou se comportent contre l’intérêt de ses utilisateurs.

Les étudiants doivent se préparer. Ils doivent apprendre à évaluer les systèmes d’IA de manière critique, tout comme la génération précédente a dû apprendre à trier les informations en ligne. Ils peuvent également signaler tout bogue informatique ou comportement inattendu qu’ils constatent afin de contribuer à leur sécurité. En outre, ils devraient participer à des conversations démocratiques pour déterminer quelles valeurs et principes devraient guider les comportements des systèmes d’IA.

Et même s’ils n’ont pas besoin d’apprendre certaines compétences qui seront automatisées, ils devraient comprendre les bases du fonctionnement de l’IA et les risques qu’elle comporte.

Michel écrit: "ChatGPT : le plagiat n’est que l’arbre qui cache la forêt « Au lieu d’essayer d’empêcher les étudiants d’utiliser ChatGPT, nous devons réformer la façon dont nous enseignons. »"

(sur Twitter du 11/02/2023)

Michèle Drechsler écrit: 20 façons d'utiliser #ChatGPT en classe

🤖 Qu'est-ce que ChatGPT ?

🏫 Quel impact cela a-t-il sur l'éducation ?

🧑🏽🏫 Comment peut-on l'utiliser en classe ?

ChatGPT, chatbots et intelligence artificielle dans l'éducation par @jmattmiller

#IAEduc #IAEdu #IA #AI

(sur Twitter du 19/02/2023)

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Quelque chose est masqué pour les invités. Veuillez vous connecter ou vous enregistrer pour le visualiser.

Connexion ou Créer un compte pour participer à la conversation.

- Loys

-

Auteur du sujet

Auteur du sujet

- Messages : 18379

Lancé fin 2022, cet agent conversationnel qui utilise l’intelligence artificielle permet de rédiger une dissertation plus que correcte en à peine une minute. Dès lors, de nombreux professeurs craignent que ChatGPT incite leurs élèves à ne plus travailler et à tricher. Au contraire, des universitaires estiment que cette technologie peut servir à transformer la manière d’enseigner et d’apprendre.

Avant Noël, une poignée d’enseignants bien informés l’ont peut-être évoqué entre collègues. Après les fêtes, ChatGPT est devenu un sujet de conversation récurrent en salle des profs.

Du collège à l’université, cette technologie basée sur l’intelligence artificielle (IA) soulève une certaine inquiétude, comme le raconte Brigitte Watteau, professeure de lettres dans un lycée de Nantes (Loire-Atlantique) : « Après l’avoir testé avec mon fils, j’ai prévenu mes collègues qu’on allait devoir changer notre manière d’enseigner… »

Veuillez fermer la vidéo flottante pour reprendre la lecture ici.

« Il y a trop de risques de triche »

Car cet agent de conversation virtuelle est capable de prouesses. Il puise dans les profondeurs d’Internet pour formuler des réponses concises – et correctement rédigées – à toutes sortes de questions. L’enseignante nantaise a donc pris une décision radicale : elle ne demande plus à ses élèves de réaliser des dissertations à la maison. « Ça ne sert à rien, il y a trop de risques de triche et c’est impossible de vérifier », pense Brigitte Watteau. D’autant plus que certains devoirs comptent dans le contrôle continu du baccalauréat.

Lire aussi : ChatGPT. 5 questions sur cet étonnant logiciel de conversation utilisant l’intelligence artificielle

S’il assure suivre « attentivement la question » , le ministère de l’Éducation estime que « le style sémantique d’une intelligence artificielle n’est pas celui d’un élève ». Et ajoute : « Les professeurs connaissent leur niveau. Le décalage entre la réponse de ChatGPT et celle d’un élève apparaîtra rapidement et ne jouera pas en sa faveur. »

« J’ai dû gagner une heure », témoigne une lycéenne

L’expérience de Pauline (le prénom a été modifié), 17 ans, démontre le contraire. En terminale dans un lycée de Paris, elle a récemment rendu un devoir d’anglais entièrement rédigé avec l’aide de ChatGPT. Son professeur n’y a vu que du feu : « J’ai eu 17/20 et la note compte pour le bac et mon dossier Parcoursup, témoigne la lycéenne, qui dit s’être servie de l’outil par manque de temps. Une fois les consignes rentrées, le logiciel m’a rendu un article très détaillé en moins d’une minute. Ensuite, il a fallu corriger quelques erreurs de syntaxe, raccourcir quelques phrases. J’ai dû gagner une heure. »

Néanmoins, l’élève confie hésiter à user de cette aide technologique à l’avenir : « Je m’oriente vers des études littéraires et ça me fait un peu flipper. Il existe aujourd’hui une intelligence artificielle qui fait mieux que moi et plus rapidement. Et puis si tout le monde s’en sert, plus personne ne saura rédiger… »

Sur Twitter et TikTok,des lycéens partagent également des lettres de motivation coécrites par le robot afin de se porter candidat à des formations post-bac sur Parcoursup :

« Dorénavant, les profs auront toujours un doute »

L’inquiétude a aussi gagné les bancs des facs. Il y a quelques jours à l’Université d’Aix-Marseille, Médéric Gasquet-Cyrus a eu « de gros soupçons » au moment de corriger la copie d’une de ses étudiantes.

Le maître de conférences en linguistique l’a convoquée dans la foulée : « J’étais surpris du niveau inhabituel de son travail sur un sujet très technique. Mais il se trouve qu’elle a vraiment bossé et n’a pas triché, raconte le Phocéen. En fait, le problème est ailleurs. Le plagiat n’est pas nouveau à l’université. Mais ChatGPT va généraliser la suspicion de fraude. Les profs auront toujours un doute quand un étudiant hausse son niveau. Ce sentiment est horrible. »

Plusieurs cas de triche ont déjà été constatés, notamment à Lyon ou à Strasbourg. Sciences Po Paris a pris les devants en interdisant l’utilisation de ChatGPT « sans mention explicite » à ses étudiants, « sous peine de sanction pouvant aller jusqu’à l’exclusion » .

Olivier Ertzscheid, chercheur à l’université de Nantes en sciences de l’information, juge quant à lui l’interdiction de l’outil « contre-productive » . Cela renforcerait le désir des étudiants de l’utiliser, comme il l’a exposé à l’AFP.

L’outil offre aussi des opportunités pour l’éducation

D’autres universitaires ne voient pas cette technologie d’un mauvais œil. Dans le milieu de la recherche, certaines voix s’élèvent pour défendre l’utilisation de l’intelligence artificielle dans le cadre éducatif.

Professeur à l’Institut Polytechnique de Paris, Antonio Casilli, parle d’un renversement de la philosophie de l’enseignement, avec des élèves obligés d’interroger la machine : « C’est une opportunité pour nous de voir comment les étudiants réalisent des tâches qu’on leur confie, de les faire travailler sur le fact-checking et de vérifier si les références bibliographiques générées sont correctes », expose l’auteur de En attendant les robots (aux éditions Seuil) auprès de l’AFP.

L’universitaire marseillais Médéric Gasquet-Cyrus pense également que ChatGPT peut devenir « un outil génial pour les profs et les étudiants » . À condition de l’utiliser « de manière intelligente », poursuit le linguiste : « Le risque ? Que des personnes en abusent pour décrocher leur diplôme et n’acquièrent aucune compétence. C’est un problème pour leurs futurs employeurs et pour elles. »

Des logiciels détectent ChatGPT, mais…

Des logiciels de détection de plagiat existent, et certains ont même été développés aux États-Unis spécialement pour les textes écrits via l’intelligence artificielle. Mais comme le soulignent plusieurs spécialistes dans un article de Libération , leurs performances sont limitées. Notamment lorsqu’un étudiant réécrit la copie générée, comme l’a fait Pauline, la lycéenne parisienne. Surtout : ils ont majoritairement été pensés pour la langue anglaise.

Dans l’Hexagone, un étudiant inscrit à l’ESAIP, une école d’ingénierie installée près d’Angers, a mis en ligne stendhalgpt.fr. Son site gratuit, basé sur un système de statistiques, promet de déterminer si un texte est écrit par un humain ou une intelligence artificielle.

Lundi 20 février, sur France info, le ministre délégué à la Transition numérique, Jean-Noël Barrot, a ajouté qu’OpenIA, la société éditrice de ChatGPT, avait tout récemment lancé son propre outil de détection : « Un filtre, pas tout à fait parfait, a-t-il concédé. Mais l’enseignement s’est toujours ajusté pour identifier la triche. J’ai confiance, nous y parviendrons. »

Au-delà des craintes du corps enseignant et plutôt que d’élaborer un plan anti-ChatGPT, l’Éducation nationale et le ministère de l’Enseignement supérieur réfléchissent surtout à la manière de s’adapter à cette innovation. Car une chose est certaine : l’intelligence artificielle va bouleverser la manière de travailler des élèves et des enseignants.

Connexion ou Créer un compte pour participer à la conversation.